AI를 통합해야 한다는 압박은 매우 큽니다. 이런 혁신을 향한 속도전은 종종 기존 거버넌스 체계 밖에서 진행되며, 그 결과 ‘섀도우 AI(Shadow AI)’라는 광범위하고 보이지 않는 리스크가 만들어집니다.

조직을 안전하게 지키려면, 먼저 섀도우 AI가 실제로 무엇인지 이해해야 합니다.

섀도우 AI는 단순히 개발자가 파일 하나를 노트북에 다운로드하는 수준이 아닙니다. 섀도우 AI는 공급망 내에 존재하는 관리되지 않는 AI 자산 전체를 의미합니다.

여기에는 서로 구분되지만, 동일하게 위험한 세 가지 구성 요소가 포함됩니다.

외부 API 호출(External API Calls): 코드 내에서 서드파티 서비스로 호출이 이루어지며, 하드코딩된 API 키와 데이터 유출 리스크가 발생할 수 있습니다.

오픈소스 모델(Open-Source Models): 공개 리포지토리에서 다운로드한 모델로 인해 공급망 오염(supply-chain poisoning) 같은 취약점이 발생할 수 있습니다.

커스텀 모델(Custom Models): 보안 스캔이 없거나 감사 가능한 계보(auditable lineage)가 없는, 조직 내부의 독자적인 자체 모델입니다.

모든 유형의 AI 리소스를 탐지하고 거버넌스로 관리하지 못하면, 조직은 데이터 유출, 악성 코드 주입, 라이선스 위반에 노출될 수 있습니다.

아래는 JFrog AI Catalog를 활용해 이를 통제할 수 있도록 돕는 5가지 실행 가능한 단계입니다.

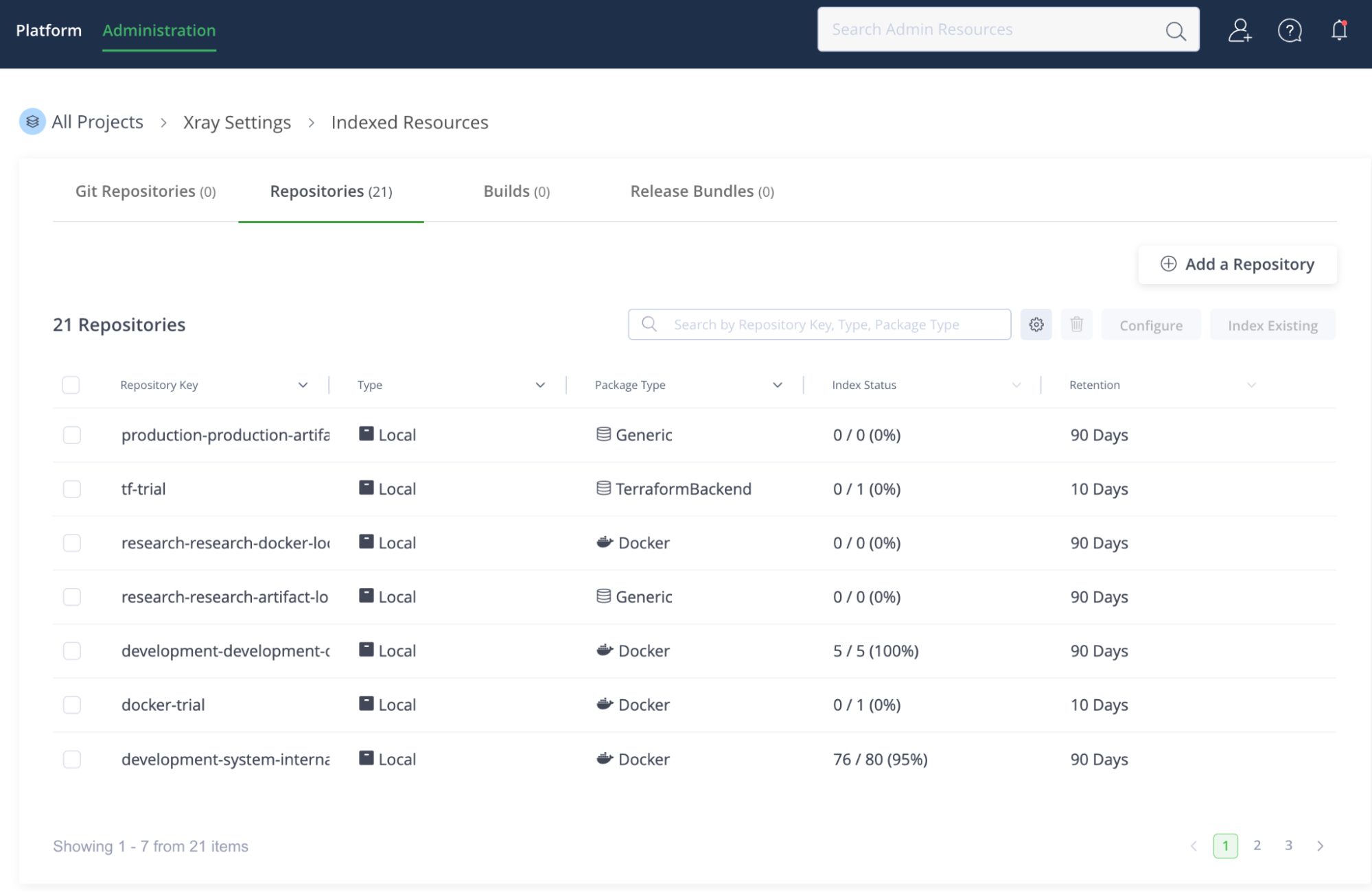

Step 1: 기존 리포지토리 스캔하기

섀도우 AI를 통제하기 위한 첫 단계는 감사를 시작하는 것입니다. 시스템 내의 모든 아티팩트, 빌드, 소스 코드 리포지토리를 스캔해 AI 사용 여부를 탐지할 수 있는 단일 메커니즘이 필요합니다.

그것이 바이너리 파일 안에 있든, API 호출 형태로 존재하든 상관없습니다.

이 과정은 JFrog의 기반 보안 구성 요소를 활용해 플랫폼 전체에서 관리되지 않는 AI 자산을 찾아냅니다.

JFrog Xray는 리포지토리와 아티팩트(예: Docker 이미지 또는 Maven 패키지)를 스캔하여 모든 커스텀 모델 또는 오픈소스 모델, 패키지, 데이터셋, 그리고 관련 의존성을 식별합니다.

JFrog Advanced Security는 소스 코드 분석을 수행해 외부 AI API(예: OpenAI, Gemini, Anthropic) 호출의 시그니처를 탐지합니다.

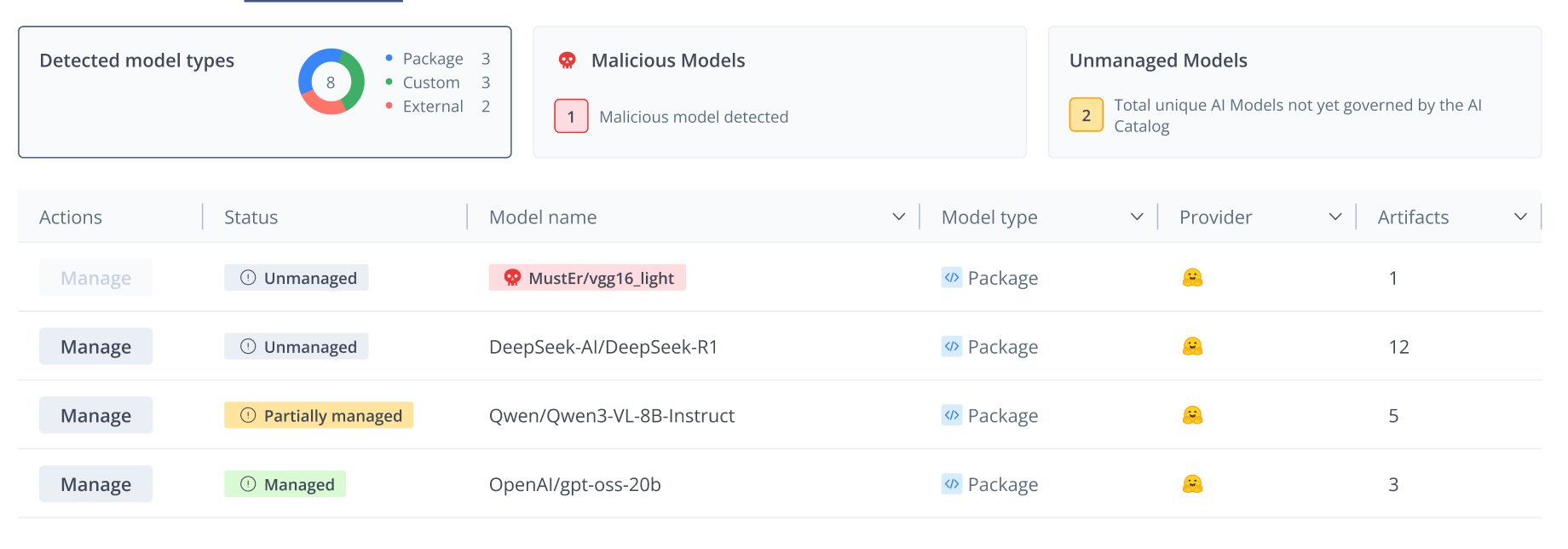

스캔이 완료되면 AI Catalog의 Detected Models 대시보드가 중앙화된 단일 기준점(source of truth)이 되어, 리포지토리와 빌드 전반에서 관리 여부와 관계없이 모든 AI 사용 사례를 보여줍니다.

Step 2: “섀도우” 인벤토리 검토하기

이제 완전한 가시성을 확보했으니, 우선순위를 정해야 합니다.

Detected Models 대시보드는 탐지 결과를 자동으로 정렬하고 분류해 주기 때문에, 가장 위험도가 높은 자산부터 먼저 집중할 수 있습니다.

아래 세 가지 기준을 활용해 검토 우선순위를 정하세요.

악성 모델 우선(Malicious Models First): Xray가 악성 또는 고위험으로 표시한 모델은 반드시 즉시 처리해야 합니다. 지금 가장 급한 불입니다.

사용 빈도(Frequency of Use): 빌드 전반에서 얼마나 자주 등장하는지 기준으로 모델을 정렬하세요. 광범위한 사용은 높은 의존도를 의미하며, 더 큰 운영 리스크로 이어지므로 빠르게 대응해야 합니다.

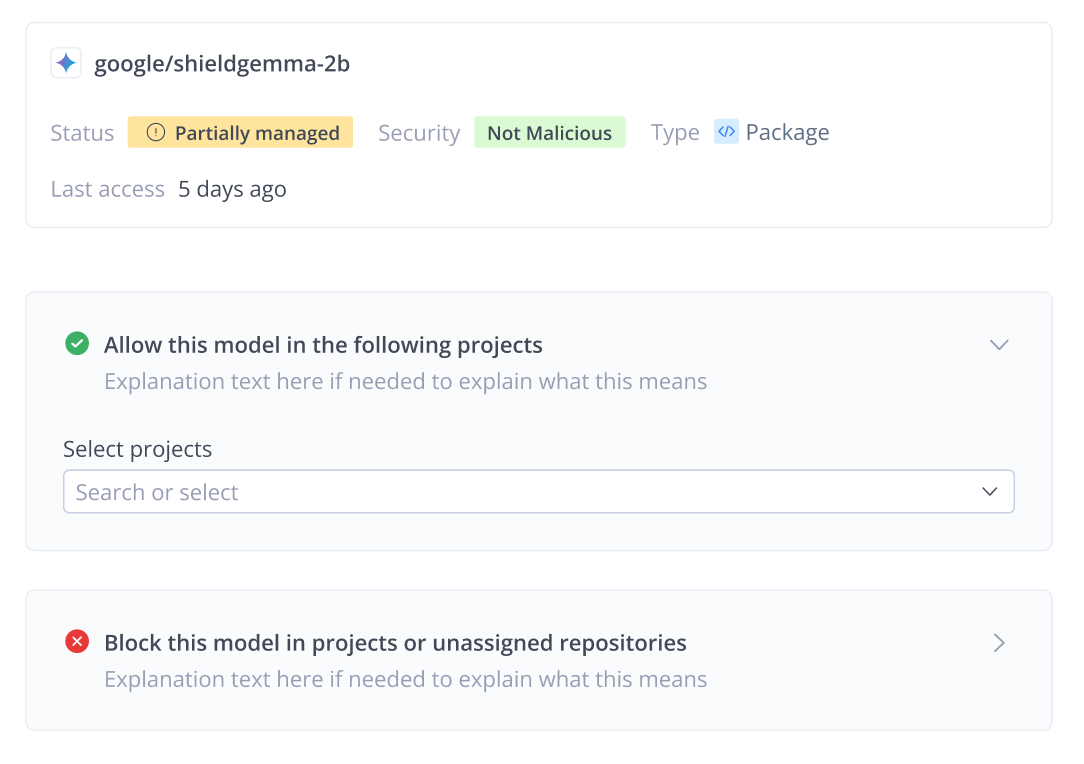

거버넌스 상태(Governance Status): 시스템은 자산을 Unmanaged, Managed, Partially Managed로 표시합니다.

이처럼 상세한 인벤토리는 거버넌스를 사후 대응에서 사전 대응으로 전환하게 만듭니다. 즉, 섀도우 AI를 단순히 ‘발견’하는 것을 넘어, 그것이 실제로 비즈니스에 미치는 영향을 이해하게 됩니다.

Step 3: 리스크 평가하기

모델을 “허용(Allow)”할지 “차단(Block)”할지 결정하기 전에, 반드시 리스크를 정량화해야 합니다. 이를 위해서는 관리되지 않는 자산이 가진 보안 및 컴플라이언스 영향에 대해 깊이 있게 검토해야 합니다.

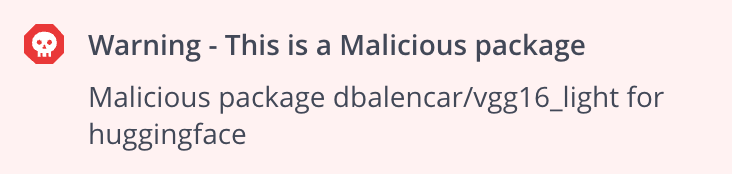

보안 리스크(Security Risk)

오픈소스 모델, 특히 Hugging Face 같은 허브에서 유통되는 모델은 네임스페이스 하이재킹(namespace hijacking) 같은 공급망 공격의 표적이 됩니다.

악성 행위자는 다운로드 시 코드가 실행되는 “오염된(poisoned)” 모델을 업로드할 수 있으며, 이는 리버스 셸 주입(reverse shell injections)과 시스템 침해로 이어질 수 있습니다.

컴플라이언스 리스크(Compliance Risk)

관리되지 않는 자산은 심각한 법적 리스크도 초래합니다. 라이선스 측면에서, 비상업용(non-commercial) 라이선스를 가진 모델을 상업용 제품에 의도치 않게 사용하는 경우 IP 법을 위반하게 됩니다.

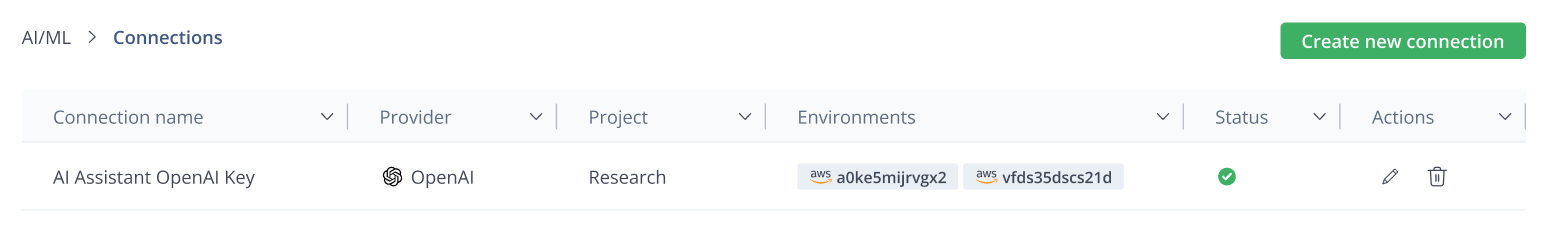

또한 OpenAI 같은 서비스에 대한 하드코딩된 API 호출은 데이터 유출 리스크를 만들며, 민감한 프롬프트와 독점 데이터가 통제된 환경 밖으로 나가 서드파티 시스템에서 처리될 수 있습니다.

이러한 위협에 대응하기 위해 AI Catalog는 JFrog Xray와 Advanced Security를 활용해 각 모델에 대한 명확한 보안 및 컴플라이언스 관점을 구축합니다.

플랫폼은 모델이 포함된 아티팩트를 스캔해 의존성 취약점을 찾고, 악성 또는 고위험 패키지를 표시하여 신속히 조치할 수 있도록 합니다. 동시에 라이선스 준수 여부를 검증하고, 코드 내 API 시그니처를 탐지합니다.

이렇게 보안 및 법적 데이터를 단일 화면으로 통합함으로써, 최종적인 거버넌스 결정을 내리는 데 필요한 감사 가능한 기록(auditable record)을 확보할 수 있습니다.

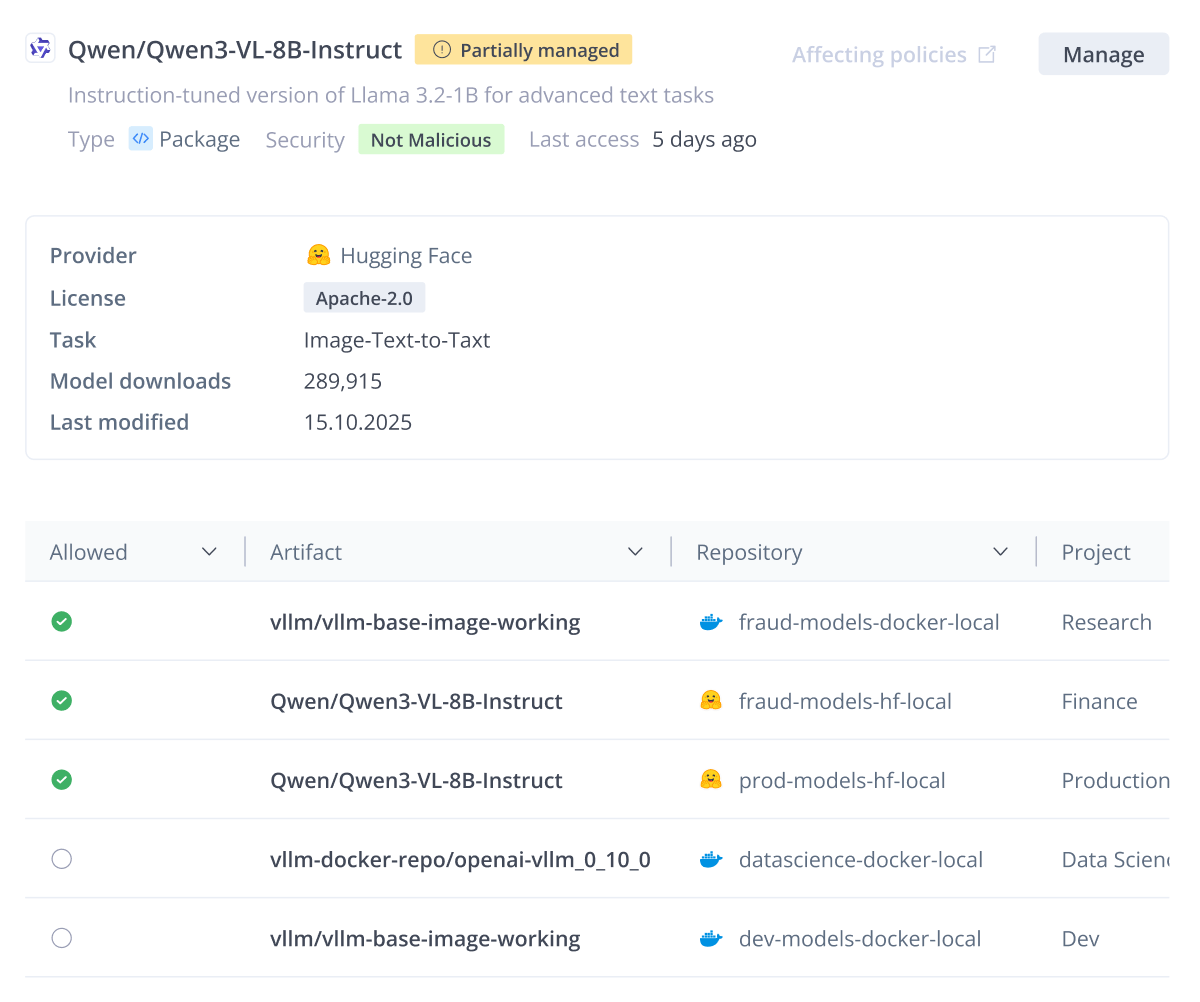

Step 4: 정책 적용(Policy Enforcement)

리스크를 정량화했다면, 이제 수동적인 관찰에서 능동적인 통제로 전환하게 됩니다. 목표는 단순합니다. 팀이 규정을 준수하고 승인된 AI 자산만 사용하도록 보장하고, 그 외의 모든 것은 차단하는 것입니다.

자산이 고위험이거나 악성이거나 정책을 위반한다면, 즉시 차단할 수 있습니다.

캐시에서 차단(Block from Cache): 모델을 “Blocked”로 표시하면, 시스템이 자동으로 Curation 정책을 생성합니다. 한 번의 동작으로 원격 리포지토리 전반에 캐시된 해당 모델의 모든 인스턴스를 제거하고, 향후 다운로드도 차단합니다.

Xray 차단 정책(Xray Block Policy): 로컬 리포지토리의 경우, Xray Download Block 정책을 적용하면 거버넌스가 적용된 프로젝트에서 해당 모델을 사용할 수 없도록 보장할 수 있습니다.

또한 Partially Managed 상태의 모델을 자주 마주치게 됩니다. 이는 불일치 상태를 의미합니다. 즉, 특정 프로젝트에서는 모델 사용이 허용되어 있지만,

아직 거버넌스 결정이 내려지지 않은 다른 프로젝트의 리포지토리에서도 해당 모델이 탐지되고 있는 상황입니다.

이런 모델을 무조건 차단하면 정상적인 워크플로우까지 깨질 수 있기 때문에, Allow 동작을 활용해 관리되지 않는 인스턴스에도 거버넌스를 확장하는 것이 좋습니다.

이렇게 하면 모델의 상태가 통합되어, 해당 모델을 사용하는 모든 팀에서 일관되게 모니터링되고 보호되도록 보장할 수 있습니다.

기존 사용 사례 관리(Managing the Existing Usage)

일부 모델은 이미 여러 팀에서 사용 중이어서, 즉시 강제 차단(hard block)을 적용하면 업무에 큰 혼란을 줄 수 있습니다. 이때 Partially Managed 상태가 핵심이 됩니다.

이 상태는 모델이 한 프로젝트에서는 허용되어 있지만, 다른 프로젝트에서는(대개 공유 리포지토리 때문에) 여전히 관리되지 않는 상태로 남아 있음을 의미합니다.

해결 방법은 Allow 동작을 사용해 남아 있는 관리되지 않는 프로젝트들도 AI Catalog의 거버넌스 적용 범위로 포함시키는 것입니다.

이를 통해 개발자에게 불필요한 실패 상태를 만들지 않으면서도, 완전히 관리되는 상태로 부드럽게 전환할 수 있습니다.

Step 5: “골든 패스(Golden Path)” 만들기

마지막 단계는 AI 자산을 차단했다면, 반드시 신뢰할 수 있는 대안을 제공해야 합니다.

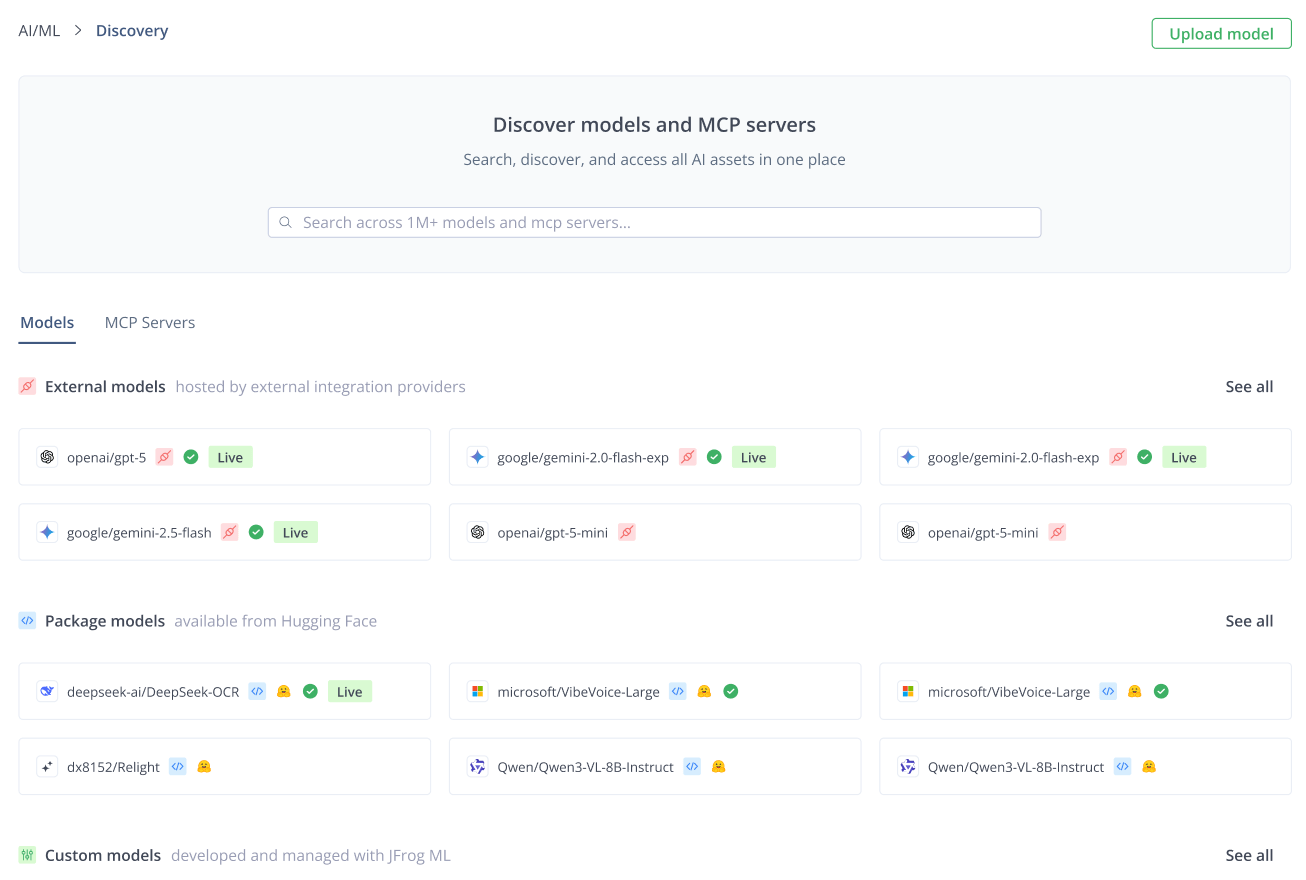

AI Catalog는 중앙화된 셀프서비스 허브를 구축함으로써 이를 가능하게 합니다.

신뢰할 수 있는 탐색(Trusted Discovery): 개발자들은 승인된 내부 모델, 오픈소스 모델, 상용 서비스를 레지스트리에서 탐색합니다. 어떤 자산을 선택하든 보안과 컴플라이언스를 충족한다는 것을 즉시 알 수 있습니다.

자격 증명 추상화(Credential Abstraction): AI Gateway는 “API Key” 문제를 해결합니다. 자격 증명 관리를 추상화하여 개발자가 원본 API 키를 직접 다루지 않도록 합니다. 개발자는 거버넌스가 적용된 서비스에 단순히 연결하기만 하면 됩니다.

거버넌스 대시보드를 단일 제어 플레인으로 전환함으로써, AI 전략을 통제되지 않는 혼란에서 신뢰할 수 있고 리스크가 조정된 속도로 바꿀 수 있습니다.

AI를 직접 통제하세요(Take Control of Your AI)

빠르게 움직이는 개발 환경에서 섀도우 AI는 피할 수 없는 현실이지만, 통제 및 관리가 완전히 불가능한 것은 아닙니다.

AI 자산이 이제 공급망의 핵심 구성 요소가 되었다는 점을 인식하면, 아티팩트 관리, 보안, 정책 적용에 대한 기존 전문성을 이 새로운 영역에도 적용할 수 있습니다.

AI Catalog는 관리되지 않는 모든 자산을 탐지할 수 있는 가시성과, 이를 거버넌스로 관리할 수 있는 제어 플레인을 제공하여, AI를 안전하고 확장 가능한 방식으로 도입할 수 있도록 보장합니다.

섀도우 AI를 제거하고 AI 워크플로우를 통제할 준비가 되셨나요? 전문가와 함께 만나 지금 바로 스캔을 실행해보세요.

JFrog 제품을 사용하고 싶으신가요?

지금 바로 커브에 문의하세요.

02-6245-5478